Bonsoir tout le monde.

Afin de ne pas "trop charger" ce post, j'ai fourni directement à Philippe quelques infos supplémentaires pour s'occuper des dBTP.

Afin de bien recadrer l'importance de toutes ces données techniques pour nous autres, écouteurs de musique en boite, voici en gros, dans l'ordre, comment l'histoire se présente.

L'audio numérique étant un système FINI, il (y) a des normes et des limites. Les franchir, ou s'en affranchir, fait que l'on sort des clous.

Les systèmes (enregistrement, lecture, conversion et j'en passe) sont conçus autour et d'après ces limites. Leur fonctionnement optimum ne peut être obtenu et garanti que si on reste dans les limites fixées. Et là, ce n'est pas par convention, c'est comme ça et pas autrement.

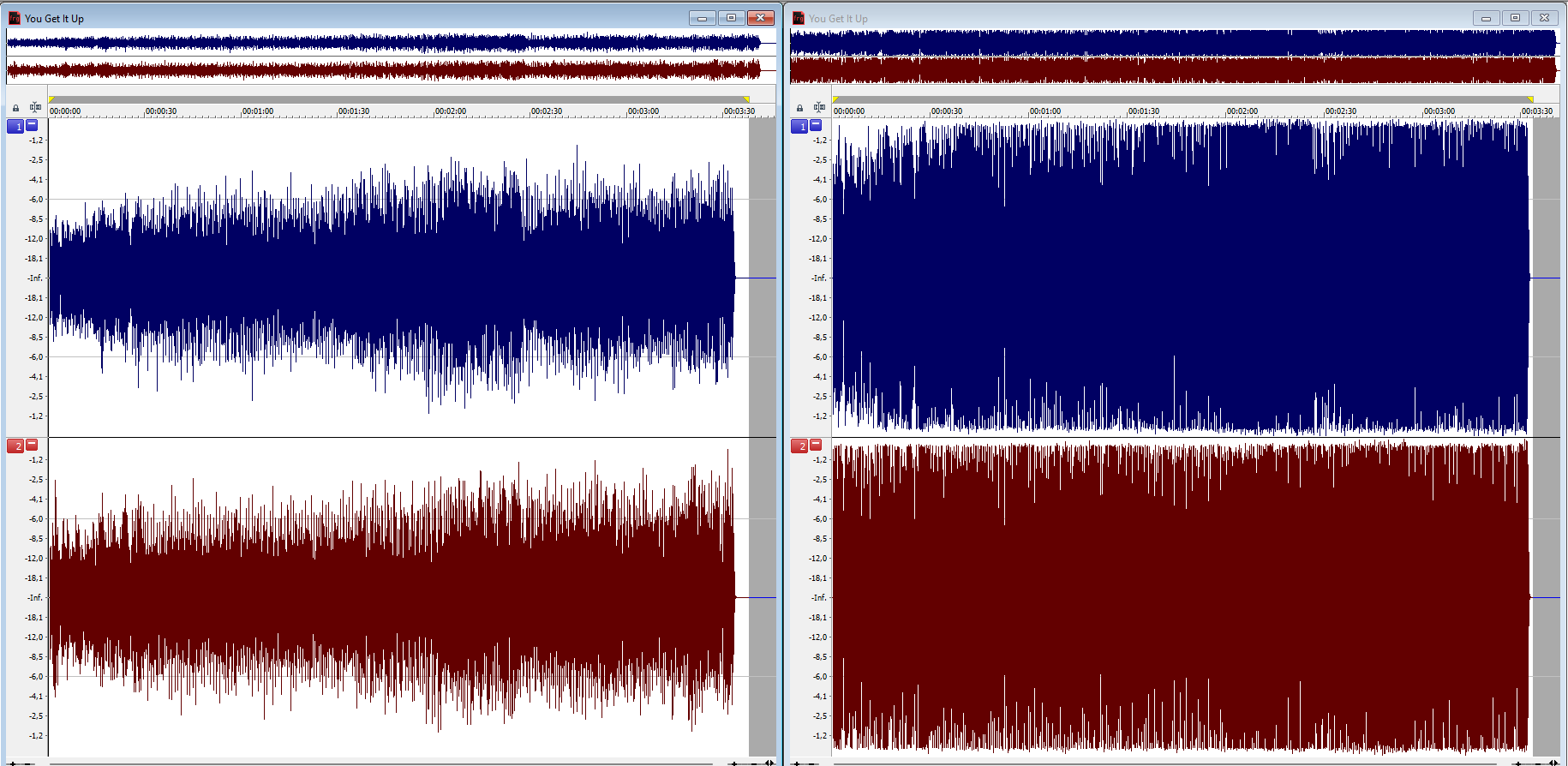

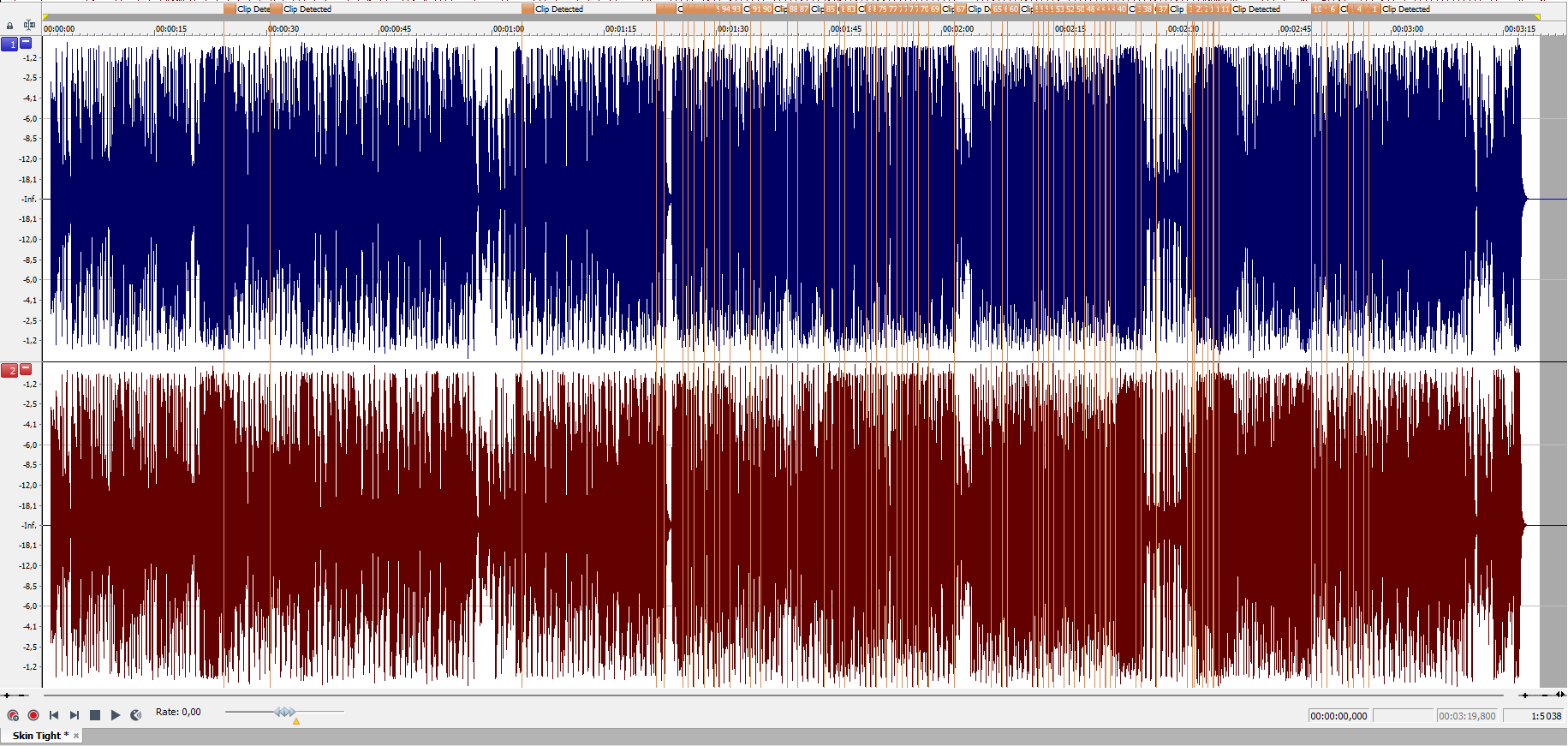

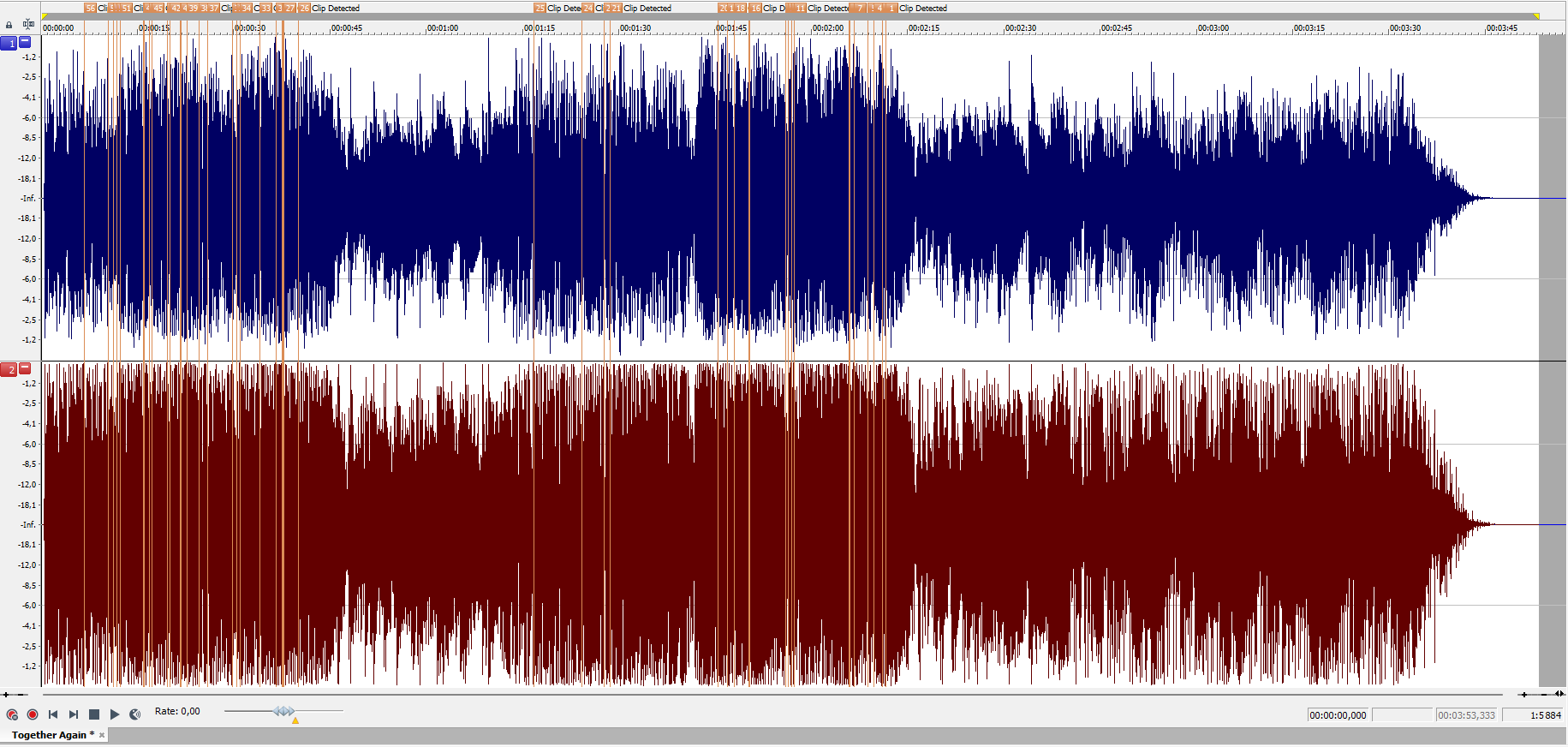

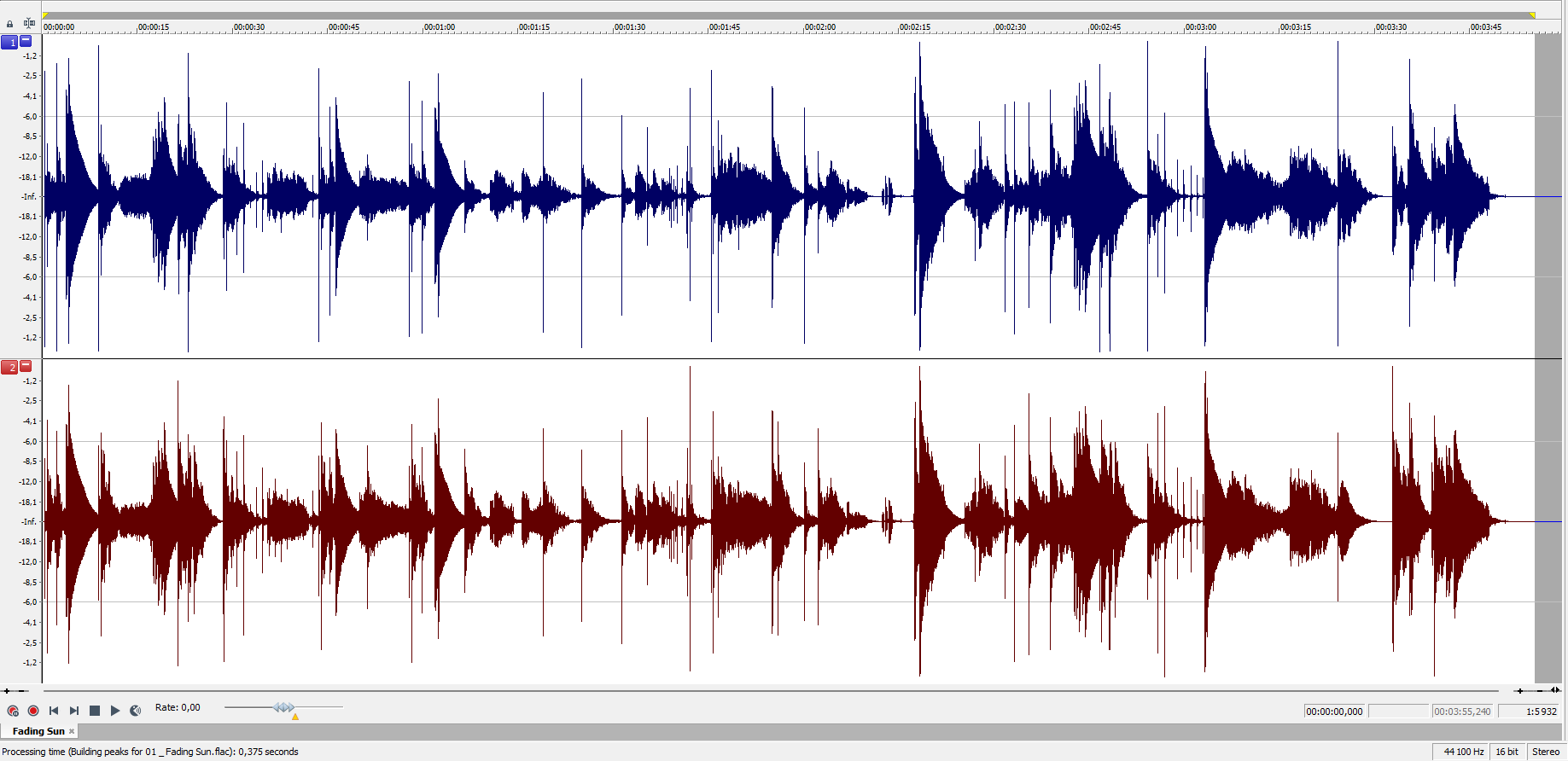

Donc, la première étape est que le contenu tienne bien dans le contenant. Ici, c'est l'affaire du fameux 0dBFS:

- Ne pas le dépasser assure de ne jamais écrêter numériquement le signal.

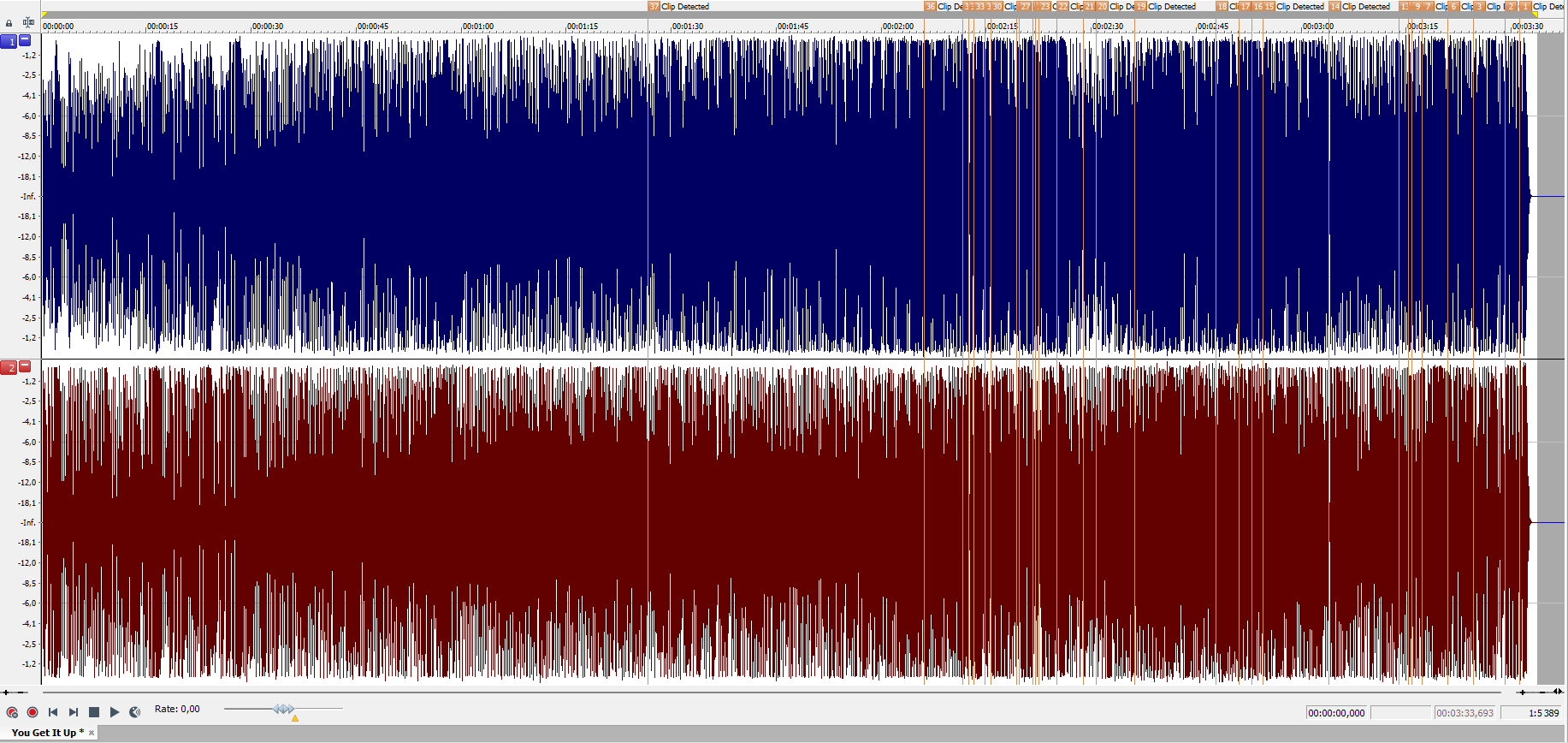

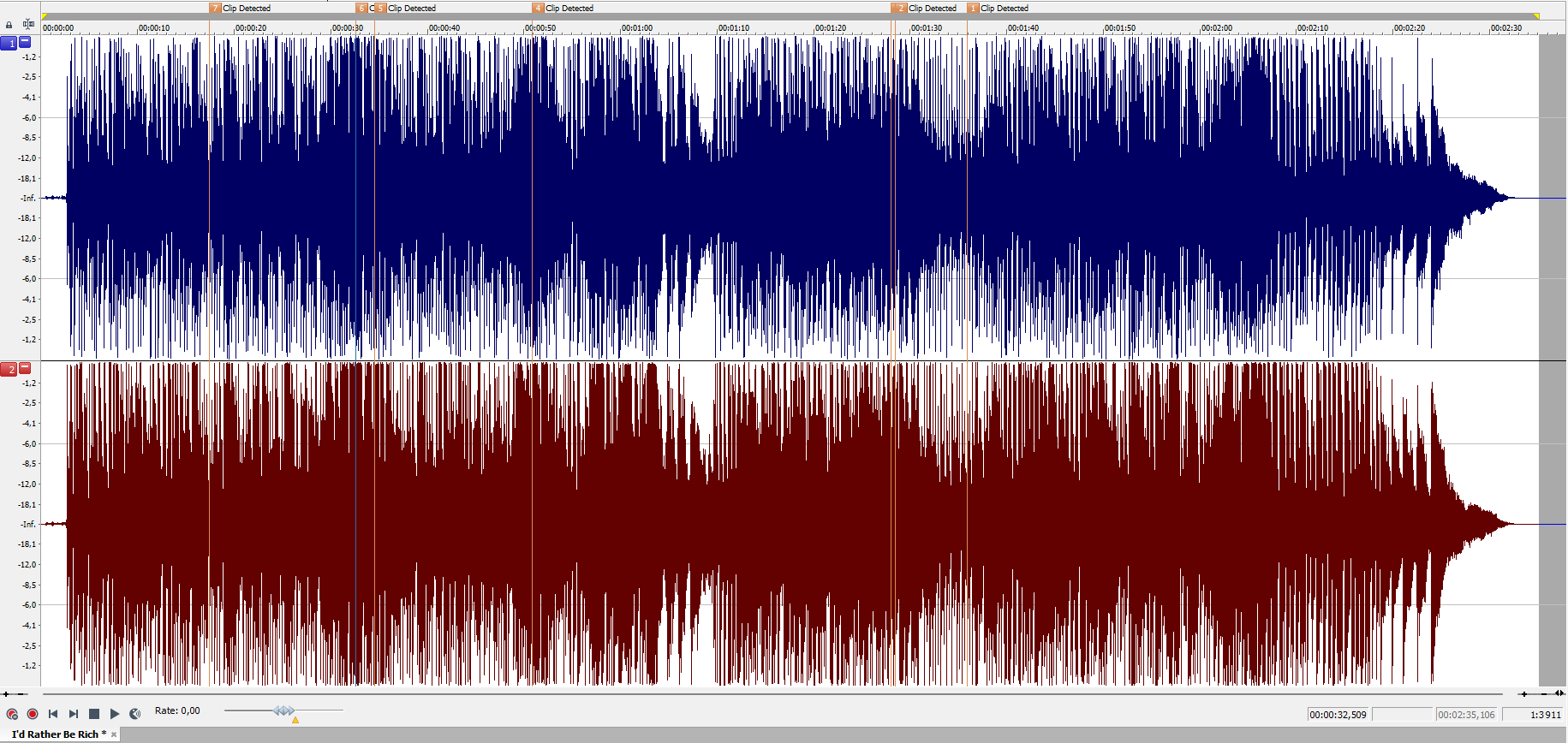

- Atteindre ce 0dBFS se fait malgré tout souvent, je le constate tout le temps durant mes analyses. Même si maintenant les DAC ne sont pas trop "paumés" et perturbés par ce niveau, ça ne leur facilite pas le boulot. D'autant que ça sert à quoi?

En résolution 16 bits, on a, en théorie, 96dB de dynamique. En 24, c'est 144. Le problème de bruit de fond avec l'enregistrement analogique à bande est aux oubliettes, surtout en 24 bits. Alors, POURQUOI vouloir chercher systématiquement le 0dBFS?

- Dépasser ce 0dBFS fera que le système, ne sachant pas comment traiter ce dernier, va générer "un truc", très audible et pas beau du tout, n'ayant rien à voir avec la Musique.

La deuxième étape, et pas des moindres, c'est de faire quelque chose avec tous ces 0&1 qui portent notre Musique.

Nous, Humains, on ne sait pas (encore) entendre et écouter des 0&1.

Au départ, on a transformé les SONS en 0&1, à l'arrivée, c'est le contraire, il faut transformer les 1&0 en SONS pour restituer la Musique.

Et c'est là que ça se corse un peu.

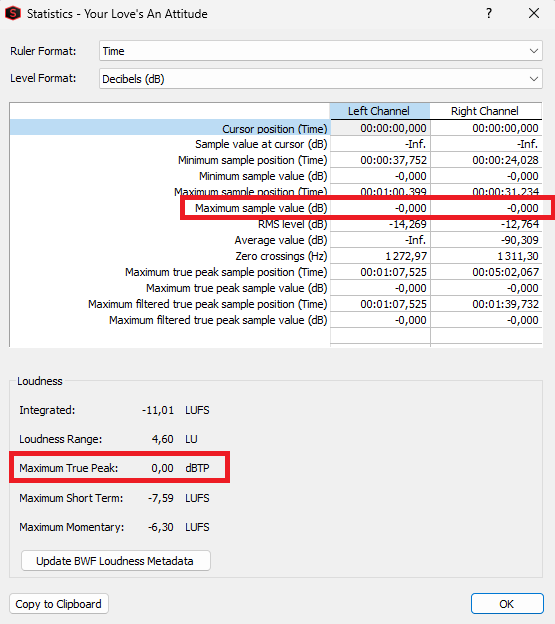

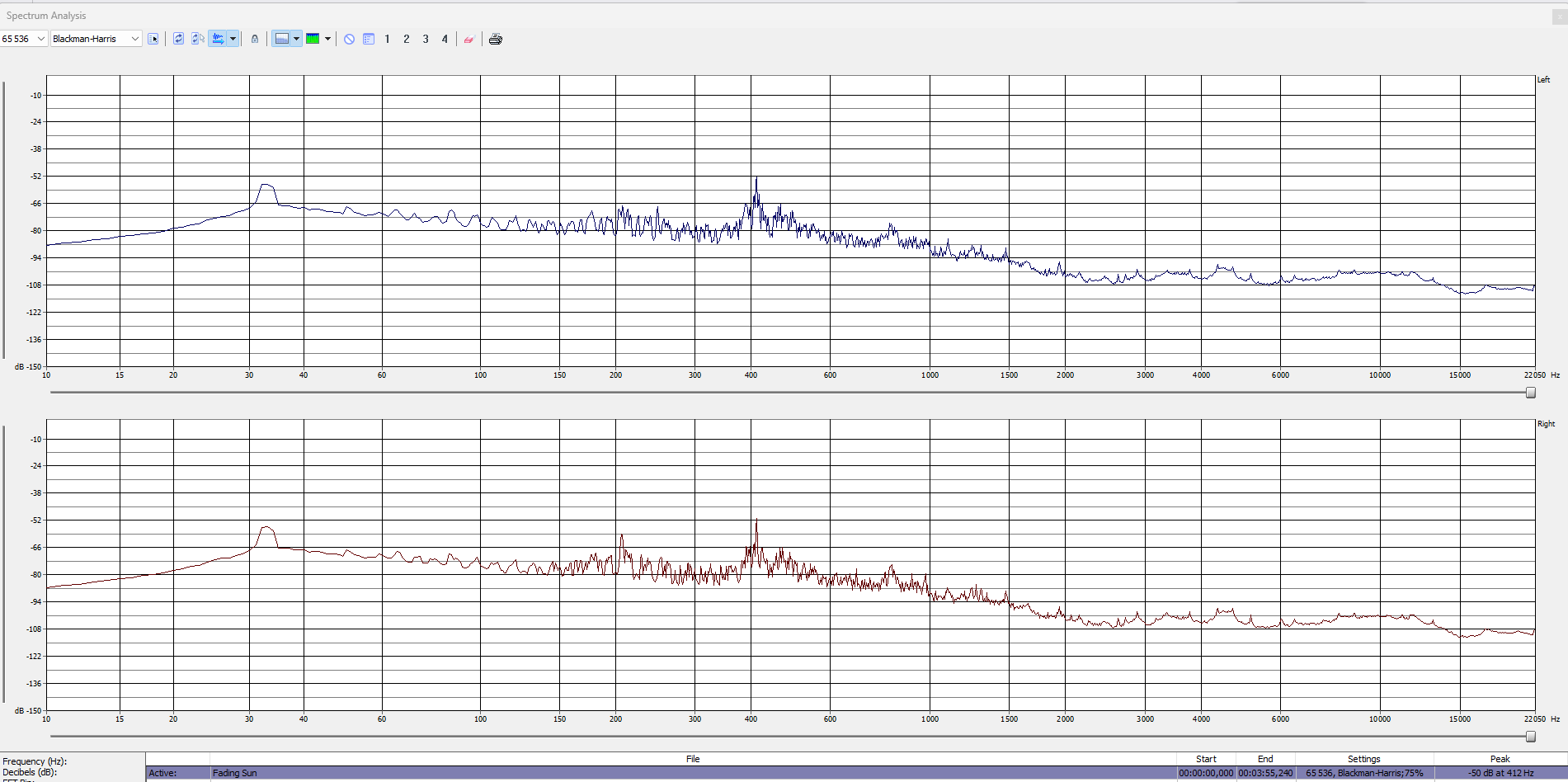

Pour revenir un peu sur ce qui a déjà été dit à propos de ces dB True Peak, quelques infos qui peuvent servir.

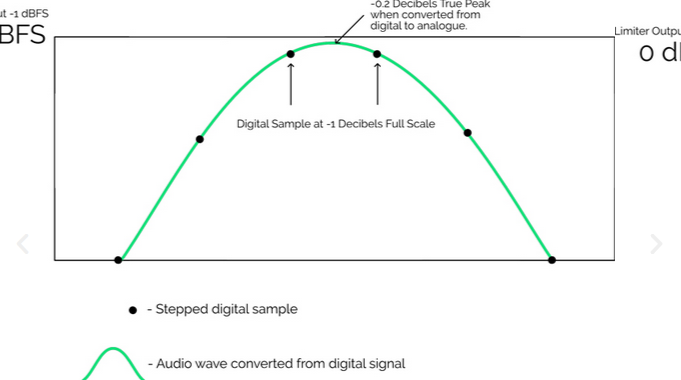

A sa sortie, le signal audio est converti de numérique en analogique et passe d’un état d'échantillons (0&1) à un état continu sous forme d'onde sonore.

C’est le travail du DAC. Il "reconnecte" les points/échantillons entre eux pour reconstruire la forme d’onde en sortie grâce à un filtre de lissage.

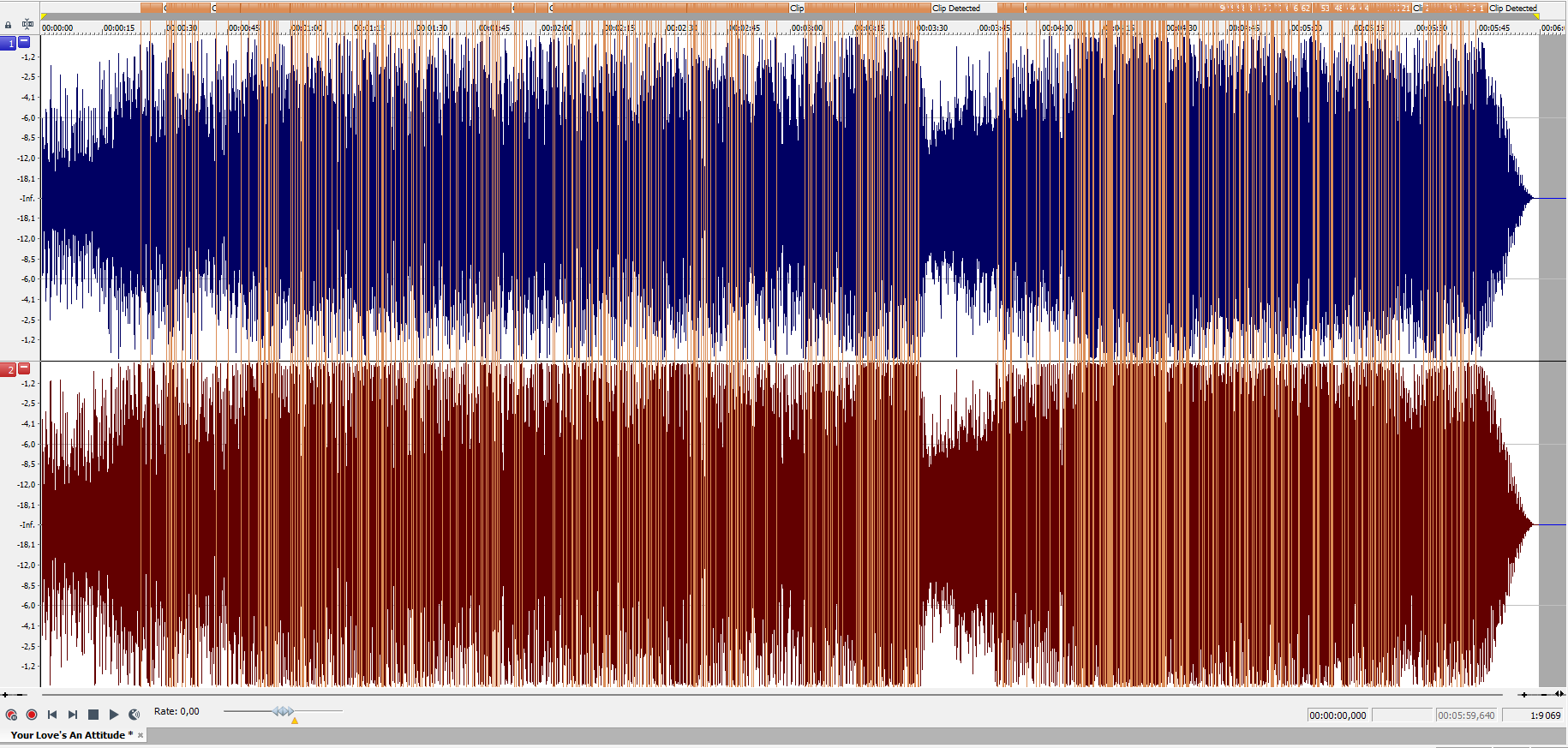

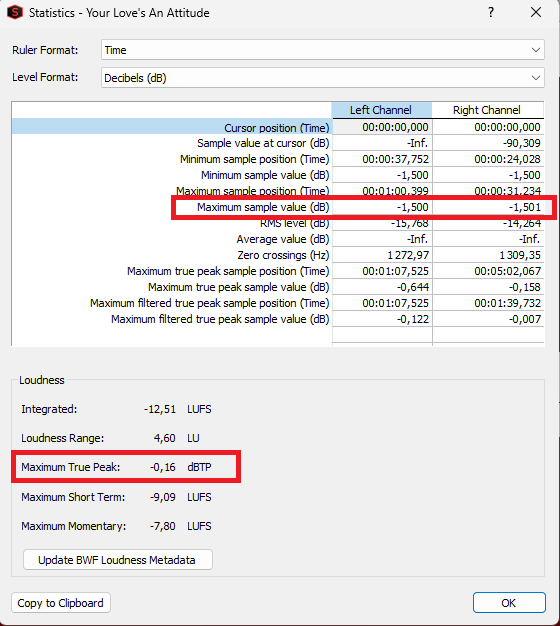

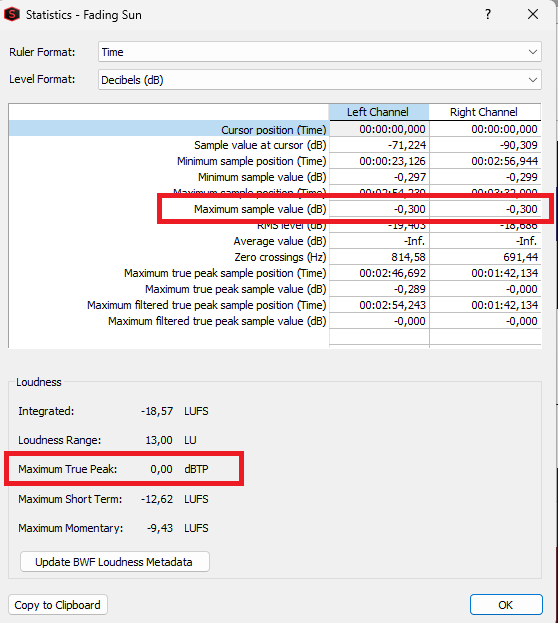

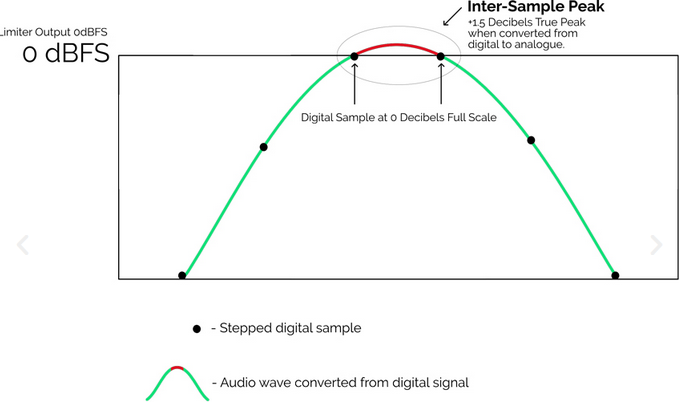

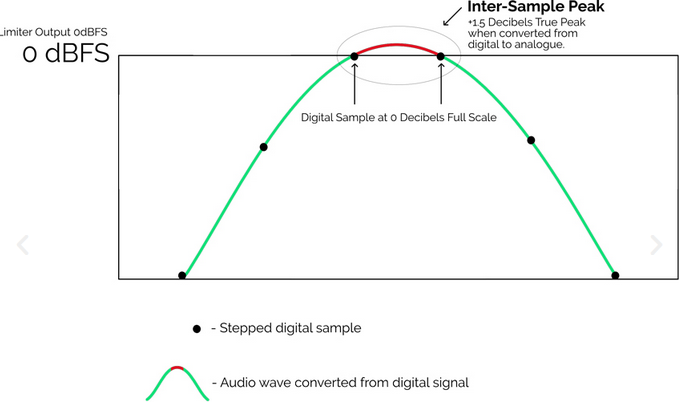

Si des échantillons sont proches de la limite 0 dBFS, il est alors possible que le filtre reconstruise ou essaie de reconstruire des crêtes légèrement supérieures au niveau correspondant à 0 dBFS (inter-sample peak, en pas Français dans le texte).

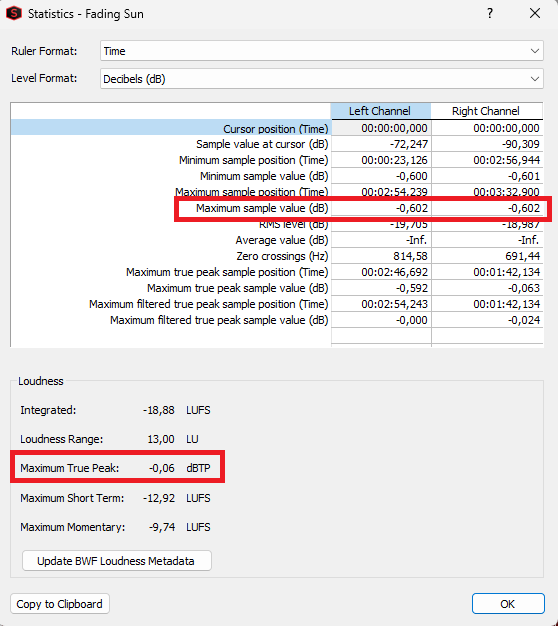

En image, ça donne ça (source Tom Frampton). Là, on voit que ça coince!

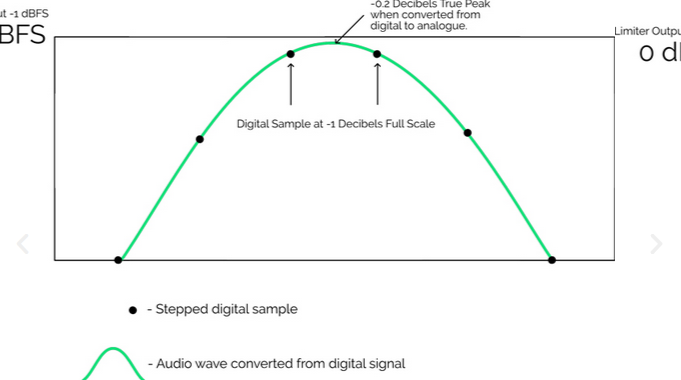

En réduisant le niveau en dBFS, ça va nettement moins mal.

Un DAC de haute qualité sait et peut, théoriquement, faire correctement le boulot. Les studios en sont équipés.

Mais quid de la chaine de Mme. Michu (avec tout le respect que je dois aux deux)?

Alors, quant à faire, autant faire propre, non?

En complément, il ne me semble pas déconnant d'évoquer la consommation actuelle de musique.

Le streaming est passé dans les mœurs et les plateformes diffusent du contenu à tout va.

Mais, souvenez vous, elles diffusent selon LEUR paramétrage qui inclut tout un tas de traitements.

Spotify suggère et propose des normalisations précises de fichiers audio afin que ceux ci ne soient pas "dénaturés" une fois "traités" par les outils Spotify.

Il faut ne pas perdre de vue que tout traitement, notamment s'il y a compression de données avec pertes, va modifier la forme de l'onde.

Si certains, ou beaucoup, parlent ou ont entendu parler "Oversampling" et "Aliasing", ces concepts sont utiles et utilisés en audionumérique mais ont aussi leurs conséquences.

Sans faire de la technique (que je ne maîtrise pas) pure et dure, un phénomène que l'on peut facilement imaginer.

Le signal à traiter est saturé. Cette saturation va générer des harmoniques, généralement très hautes. Si on prend un contenant 16/44 et que ces fréquences indésirables soient 32kHz par exemple, le système ne sait pas quoi en faire.

Les règles d'échantillonnage vont alors la faire "pivoter" sur 12kHz. Et non seulement c'est dans notre zone d'audition, mais en plus, elle n'a rien à faire là.

La cohérence musicale est perturbée. En théorie, les filtres anti-alias corrigent ça, mais...

Alors, quand on peut, disposer de fichiers correctement construits permet une écoute dans de bonnes conditions.

Quand certaines distorsions analogiques sont agréables (ou peuvent l'être) à l'oreille, il n'en va pas de même avec le numérique.

Ne soyez pas étonnés si, lors d'une écoute depuis une plateforme en ligne, la musique ne vous semble pas "comme il faut".

Tous les traitements qu'elle subit peuvent, en certaines circonstances, finir par s'entendre.

N'oubliez pas, si la vue accepte des distorsions de dizaines de %, l’ouïe est très sensible, tant en niveau qu'en déformations.

Même si l'immense majorité des écouteurs de Musique vivent très bien avec tout ça, il n'est peut-être pas inutile et incongru de connaitre quelques grandes lignes. Cela peut éviter de partir dans toutes les directions pour corriger ça ou ça. Si la source est polluée, la source est polluée.

Écouter à partir d'un truc propre, ou le plus propre possible, est, à mon sens, un bon début.

A bientôt pour la suite...